En 2015, la reconnaissance visuelle d’images sur smartphone a atteint sa phase de maturité.

Un grand nombre d’applications mobiles utilisant ce type de technologie existent désormais et semblent bien rodées. Elles permettent aussi bien de reconnaître des tableaux dans des musées que des couvertures de livres, de CD ou de DVD, ou même des publicités dans la rue. En liant les images reconnues à un site mobile, ces applications nous permettent d’avoir accès des informations complémentaires relatives à l’objet.

Cette technologie peuvent-elle être désormais élargie à d’autres domaines plus scientifiques et pourrait-on les utiliser sans risque dans le domaine de la e-santé et notamment comme aide au diagnostic médical ?

voici un petit panorama d’applications mobiles significatives utilisant la reconnaissance d’images à des fins commerciales, pédagogiques et médicales.

Comment marche la reconnaissance d’images sur un smartphone ?

Il existe actuellement 4 formes de reconnaissance d’images :

- la reconnaissance simple : c’est l’identification d’un objet prédéfini (un objet ou une image que je connais et que j’incorpore à la base de données.

Exemple : une affiche de cinéma ou un meuble précis. Elle est utilisée en générale à des fins publicitaires ou commerciales; comme l’application mobile des magasins BUT permettant de faire un lien entre la catalogue papier et un contenu complémentaire sur mobile (vidéo de présentation, notice de montage…)

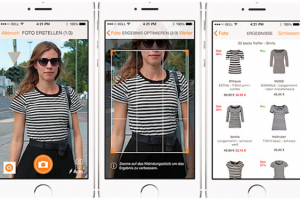

- La recherche d’image par le contenu : à partir d’une image source (la photo prise), l’algorithme va donner une liste de résultats en images (de la plus approchante à la moins approchante). C’est le principe de l’application Zalando qui utilise la reconnaissance d’images et permet de prendre en photo n’importe quelle tenue et d’accéder sur l’application mobile à un modèle similaire distribué par la marque puis de l’acheter en ligne.

- La catégorisation : consiste a attribuer une classe/catégorie à une image donnée. Le résultat obtenu ne peut être que positif ou négatif (pas de %). Elle indiquera par exemple si une image précise est plutôt de type animal ou végétal.

- La détection : savoir si un objet appartenant à une catégorie donnée se trouve sur une image et à quelle endroit.

Exemple : Google Street view utilise la détection d’images pour identifier des visages ou des plaques d’immatriculation et les flouter.

Focus sur PlantNet : une application scientifique permettant l’identification de fleurs et de plantes sauvages.

Lancée en 2013 par un consortium de partenaires scientifiques français (Inria-Inra-Cirad-Ird et le réseau Tela Botanica), cette application intègre un système d’identification automatique des plantes à partir de photos, par comparaison avec les images d’une base de données botaniques riche de plus de 100 000 images selon la page Facebook de l’application.

https://itunes.apple.com/fr/app/plantnet/id600547573?mt=8

La force de PlantNet réside dans l’apprentissage : plus il y a de photos dans la base de données, plus le logiciel est précis dans son identification (principe du machine learning). Les plantes photographiées sont identifiées avec une précision croissante en intégrant au fur et à mesure les éléments caractéristiques de telle ou telle espèce. La plupart des images sont fournies par une plateforme collaborative alimentée par des botanistes professionnels ou des amateurs éclairés qui apportent chaque jour des images de bonne qualité, décrite avec précision. Les autres clichés sont fournis par les 14 000 membres de Tela Botanica.

Selon la principe de la recherche d’image par le contenu, à partir d’une photo prise par l’utilisateur, le serveur donne plusieurs solutions, de la plus ressemblante à la plus éloignée.

Catégorisation manuelle des clichés : une fois la photo prise, l’application demande s’il s’agit d’une feuille, d’une fleur, d’un fruit ou d’une écorce avant de lancer une recherche d’image ciblée.

Géolocalisation des clichés : les botanistes espèrent également récupérer des éléments plus précis sur les aires de répartition de chaque espèce végétale et suivre notamment l’avancée des plantes invasives.

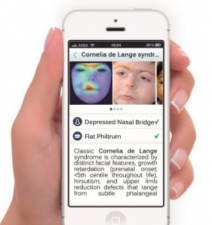

Focus sur Face2Gene : une application médicale facilitant la détection des caractéristiques faciales dysmorphiques et des marques reconnaissables de malformations humaines à partir de photos de visages.

Cette application très poussée est éditée par la FDNA (Facial DysmorphologyNovelAnalysis) basée à NY (USA). Elle est strictement réservée aux professionnels de santé en exercice via login/pswd attribué par l’éditeur

https://itunes.apple.com/fr/app/face2gene/id533737939?mt=8

Elle permet aux spécialistes en génétique en cas de suspicion de la maladie chez un patient de prendre plusieurs clichés via leur smartphone et de les comparer avec une base de données de cas positifs comprenant plus de 100 000 clichés répertoriés et commentés. La solution tire profit des algorithmes sophistiqués et de l’expérience cumulée de centaines de professionnels de la génétique et de centaines de milliers de cas analysés. Tout comme PlantNet, La technologie de la FDNA s’améliore au fil du temps, référençant des très nombreuses bases de données de phénotypes notamment la LONDON MEDICAL DATABASE (LMD)très riche en cas et clichés et reconnue dans la génétique depuis plus de 20 ans. Ces éditeurs tiers capitalisent eux-même sur les expériences cliniques de leurs médecins contributeurs.L’ensemble des dossiers constitués via l’application Face2Gene et mise à disposition de la communauté de spécialistes en génétique sont bien sur anonymisés.

La reconnaissance d’images pour détecter un cancer de la peau ! Fiction ou réalité ?

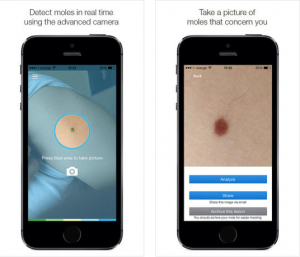

Depuis 3 ans certaines applications mobiles utilisent les technologies de reconnaissance d’images » afin de permettre la détection précoce des cancers de la peau ». Rappelons qu’aux USA, le cancer de la peau représente actuellement près de la moitié de tous les cancers et qu’en 2013 on y a répertorié plus de 76 000 cas de mélanome, la forme la plus mortelle de la maladie.

Les symptômes du cancer de la peau comprennent généralement un changement dans la taille où la couleur d’une tache sur la peau où une croissance de cette dernière. La plupart des applications proposent ainsi la prise de clichés des taches et grains de beauté suspects à instant t et t+1 et visent à informer les individus en cas d’évolution avérée.

Premier exemple, l’application Doctor Mole Skin Cancer permet l’analyse des grains de beauté en utilisant la méthode « ABCDE » (asymétrie, bordure, couleur, diamètre et évolution) utilisée par les dermatologues. L’application calcule ensuite le risque de cancer de la peau d’une personne en fonction des caractéristiques de leurs taches.

Autre exemple avec l’application SkinVision qui utilise une théorie mathématique appelée «géométrie fractale » permettant d’analyser les photos de lésions cutanées prises par l’utilisateur. Selon les fabricants, SkinVision est la première application à utiliser cette théorie pour la détection précoce du mélanome.

Un auto-diagnostic pouvant s’avérer dangereux pour les patients

En cherchant un peu, on s’aperçoit que les stores de Google et d’Apple sont désormais envahis par ce type d’applications dermatologiques. L’augmentation de la résolution des appareils photos embarqués sur les smartphones conjugués à la puissance des algorithmes disponibles permettent désormais de mettre entre les mains de tous des dispositifs technologiques sophistiqués.

Passons sur l’aspect business de ces applications ! (la plupart sont en effet payantes au travers de modèles économiques souvent élaborés). Le problème qu’elles posent est qu’elles incitent à l’auto-diagnostic des patients. Même si elles regorgent toutes d’indications du type « l’application ne remplace pas un avis médical professionnel » et d’informations préventives, les patients les téléchargent massivement pour « checker » immédiatement leurs taches et grains de beauté suspects.

En 2013, dans une étude publiée par la très sérieuse revue JAMA dermatologie, des universitaires américains ont analysé quatre applications mobile qui prétendent détecter le cancer de la peau via reconnaissance d’images et algorithme. Les chercheurs leurs ont soumis 188 images de lésions cutanées. Selon l’étude, 30 % ou plus des mélanomes n’ ont pas été diagnostiqués ni repérés par ces applications et ont donné des résultats trompeurs : des mélanomes diagnostiqués mortelles analysés comme «insignifiant». C’est le vrai danger de ces applications : faire passer l’utilisateur à côté d’un mélanome avéré et retardé ainsi le diagnostic que seule une consultation réelle chez un dermatologue pourra faire.

http://archderm.jamanetwork.com/article.aspx?articleid=1557488&resultClick=3

Selon le docteur Darrell Rigel du Centre médical de NYU Langone à New York :

«Il est très important que ces applications ne soient pas utilisées par les patients eux même, car elles pourraient conduire à un retard dans le diagnostic du mélanome, cancer qui peut être critique, s’il n’est pas diagnostiqué suffisamment tôt » .

Conclusion : la reconnaissance d’images est une vrai avancée en matière de santé à condition qu’elle soit utilisée par des professionnels de santé comme aide au diagnostic.

Il ne s’agit pas de repousser massivement les applications de e-santé. Il peut être intéressant pour tous de surveiller son poids, sa tension artérielle où l’indice ultra-violet du moment.

En revanche les applications de diagnostic de pathologies lourdes comme le cancer où la dysmorphie faciale utilisant la reconnaissance d’images où d’autres technologies doivent être réservées strictement aux professionnels de santé spécialisés et intervenir uniquement dans un processus d’aide au diagnostic.

Au final, les applications de santé peuvent trouver leur utilité lorsqu’elles sont pédagogiques, si elles permettent l’analyse prédictive ou si elles incitent au dialogue avec le médecin. Elles ne devraient pas conduire à l’auto diagnostic et encore moins à l’auto médication si elles ne veulent pas faire plus de mal que de bien. Les technologies de nos smartphones ne cessent de progresser et cela restera une très bonne chose pour la santé publique à condition que tous, patients, développeurs et professionnels de santé sachent faire preuve de bon sens et de discernement.

Brice Nadin

Digital Consult France

21/08/2015

sources :

FDNA, http://www.fdna.com/face2gene/

PlantNet, http://www.plantnet-project.org/page:MOBILE

Medical News today, www.medicalnewstoday.com/articles/285751